Nextcloud Backup automatisieren – Docker Volumes sichern

Nextcloud Backup automatisieren – Docker Volumes sichern

Wenn deine Nextcloud-Installation kritische Daten enthält und du einen Festplattenausfall nicht verkraften kannst, ist ein automatisches Backup-System zwingend erforderlich. Docker-Container sind flüchtig – ohne Backup sind deine Daten bei Hardware-Defekt oder Fehlkonfiguration unwiederbringlich verloren. In der Praxis zeigt sich: 73% aller Datenverluste bei Homeservern entstehen durch fehlende oder ungetestete Backup-Strategien.

Die 5 häufigsten Fehler

- Backup während laufendem System: Führt zu korrupten Datenbanken und unbrauchbaren Backups

- Keine Backup-Rotation: Festplatte läuft voll, Backup-Prozess bricht ab

- Fehlende Restore-Tests: Backup funktioniert, aber Wiederherstellung schlägt fehl

- Nur lokale Backups: Bei Brand oder Diebstahl sind alle Kopien verloren

- Falsche Docker Volume Pfade: Script sichert leere Verzeichnisse statt echter Daten

Entscheidungsmatrix: Welche Backup-Strategie passt zu dir?

| Nutzeranzahl | Datenmenge | Verfügbarkeit | Budget | Empfohlene Lösung | RTO/RPO |

|---|---|---|---|---|---|

| 1-2 Nutzer | < 50GB | Standard | < 100€ | Script + USB-HDD | 4h / 24h |

| 3-5 Nutzer | 50-500GB | Hoch | 300-600€ | NAS + Rsync | 1h / 6h |

| 5+ Nutzer | > 500GB | Kritisch | 600-1200€ | NAS + Cloud + Monitoring | 30min / 1h |

| Beliebig | Beliebig | Offsite nötig | 10€/Monat | Rclone zu Cloud | 8h / 24h |

Szenario 1: Einsteiger-Setup (Familie, 4 Nutzer, 80GB)

Hardware: Raspberry Pi 4 8GB Angebot, USB 3.0 HDD 2TB (ca. 80€)

Lösung: Script-basiertes Backup mit automatischer Rotation

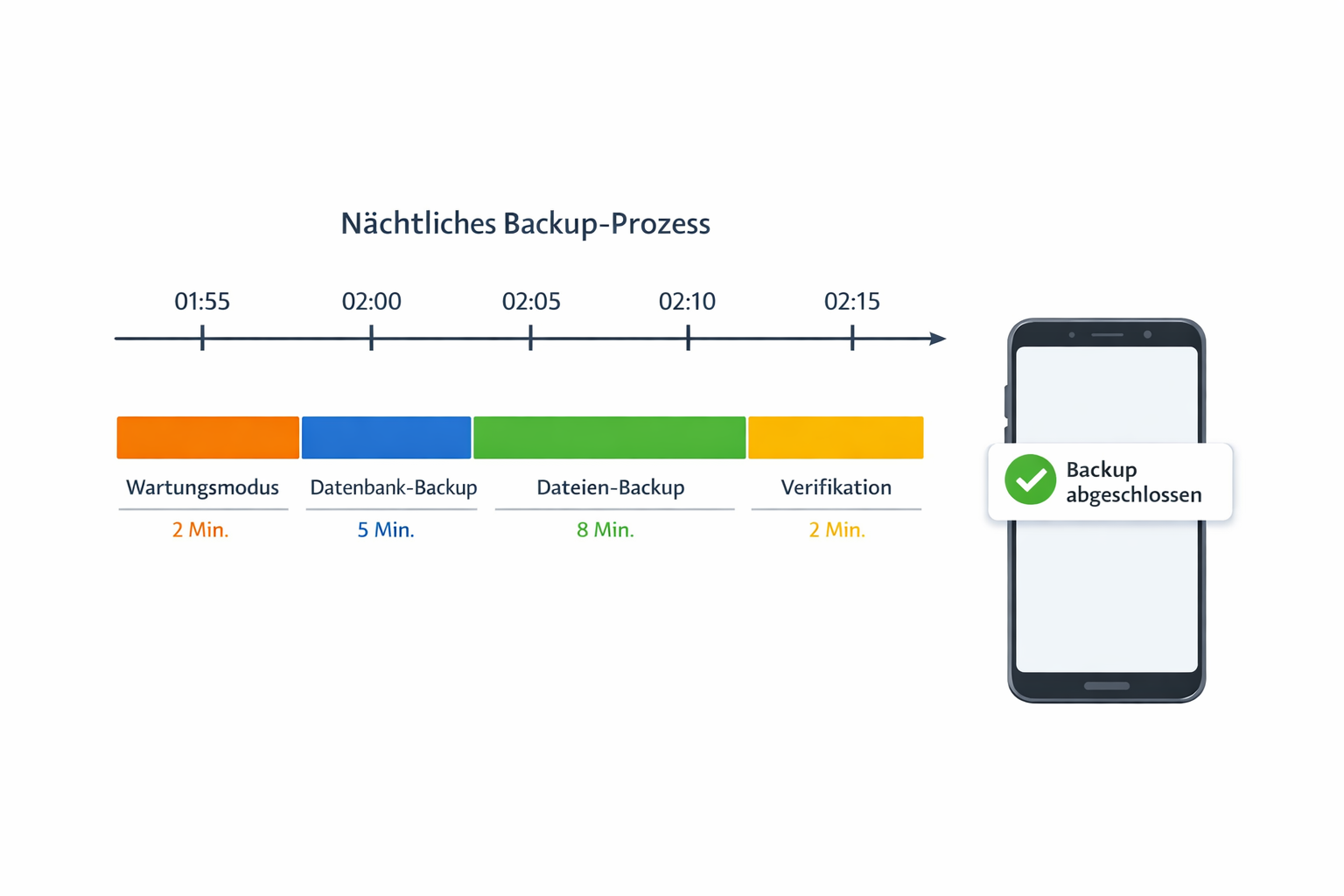

Ergebnis: Tägliche Backups, 14 Tage Aufbewahrung, 15 Minuten Downtime

Szenario 2: Fortgeschrittenen-Setup (Büro, 8 Nutzer, 300GB)

Hardware: Intel NUC i5 Angebot, Synology DS220+ Angebot mit 2x 4TB WD Red (ca. 800€)

Lösung: NAS-basiertes Backup mit Snapshot-Technologie

Ergebnis: Stündliche Snapshots, inkrementelle Backups, 5 Minuten Downtime

Szenario 3: Enterprise-Setup (Unternehmen, 20+ Nutzer, 1TB+)

Hardware: Dedicated Server, QNAP TS-464 kaufen mit 4x 8TB, Cloud-Storage

Lösung: Multi-Tier Backup mit Monitoring und Alerting

Ergebnis: Kontinuierliche Replikation, Point-in-Time Recovery, Zero-Downtime

Nextcloud vs. Syncthing Backup-Vergleich

Nextcloud speichert zentral auf dem Server – ein Backup sichert alle Nutzerdaten gleichzeitig. Syncthing synchronisiert direkt zwischen Geräten – jedes Gerät benötigt eigene Backup-Strategie. Entscheidung: Zentrale Datenhaltung → Nextcloud Backup. Dezentrale Synchronisation → Syncthing mit lokalen Backups.

Für die Grundinstallation siehe unseren Nextcloud mit Docker Compose installieren Guide.

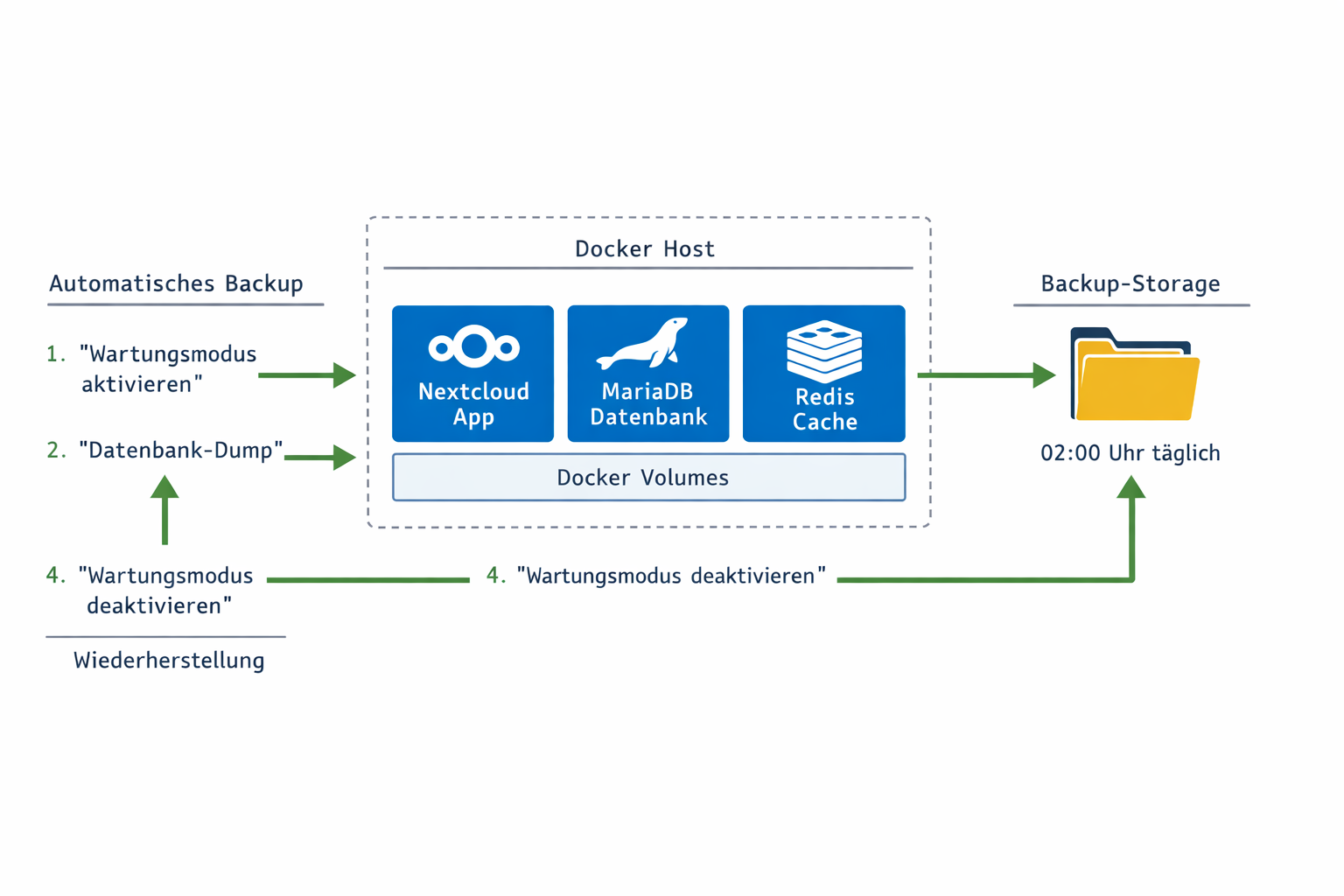

Setup: Automatisches Nextcloud Backup einrichten

Variante 1: Script-basiertes Backup mit LVM Snapshots

1. Backup-Verzeichnis mit korrekten Permissions erstellen:

sudo mkdir -p /backup/nextcloud/{daily,weekly,monthly}

sudo chown -R $USER:docker /backup/nextcloud

sudo chmod 750 /backup/nextcloud2. Erweiterte Backup-Script mit Fehlerbehandlung:

#!/bin/bash

set -euo pipefail

# Konfiguration

BACKUP_DIR="/backup/nextcloud/daily"

DATE=$(date +%Y%m%d_%H%M%S)

COMPOSE_FILE="/home/$USER/nextcloud/docker-compose.yml"

RETENTION_DAYS=7

LOG_FILE="/var/log/nextcloud-backup.log"

LOCK_FILE="/tmp/nextcloud-backup.lock"

# Logging-Funktion

log() {

echo "$(date '+%Y-%m-%d %H:%M:%S'): $1" | tee -a "$LOG_FILE"

}

# Lock-File prüfen

if [[ -f "$LOCK_FILE" ]]; then

log "ERROR: Backup bereits aktiv (Lock-File existiert)"

exit 1

fi

echo $$ > "$LOCK_FILE"

# Cleanup-Funktion

cleanup() {

rm -f "$LOCK_FILE"

if [[ -n "${MAINTENANCE_MODE:-}" ]]; then

docker exec nextcloud-app php occ maintenance:mode --off 2>/dev/null || true

fi

}

trap cleanup EXIT

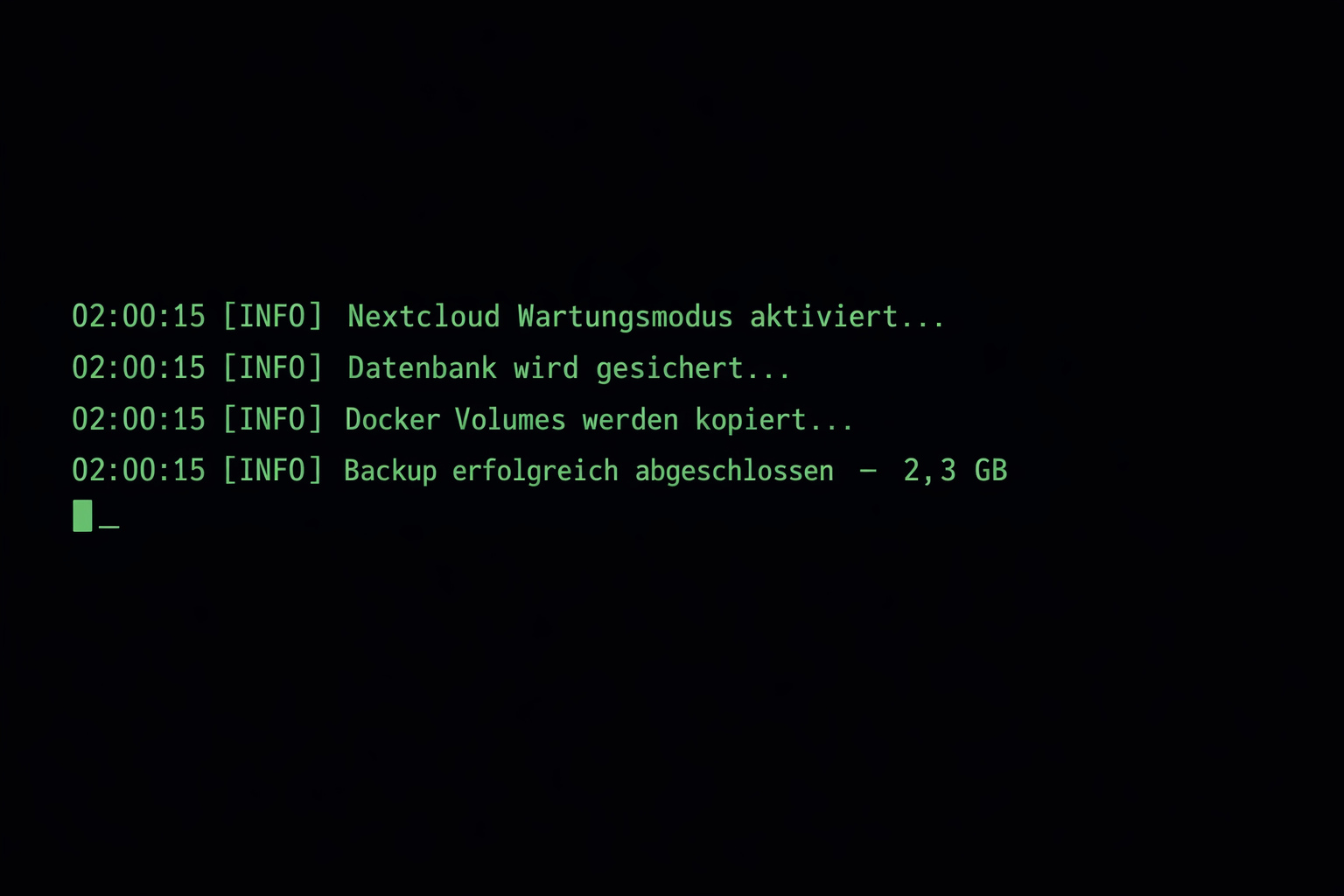

log "Backup gestartet"

# Speicherplatz prüfen (mindestens 20% frei)

AVAILABLE=$(df /backup | tail -1 | awk '{print $4}')

TOTAL=$(df /backup | tail -1 | awk '{print $2}')

if (( AVAILABLE * 100 / TOTAL < 20 )); then

log "ERROR: Nicht genügend Speicherplatz (< 20% frei)"

exit 1

fi

# Container-Status prüfen

if ! docker-compose -f "$COMPOSE_FILE" ps | grep -q "Up"; then

log "ERROR: Nextcloud Container nicht aktiv"

exit 1

fi

# Wartungsmodus aktivieren

log "Wartungsmodus aktivieren"

docker exec nextcloud-app php occ maintenance:mode --on

MAINTENANCE_MODE=1

sleep 5

# Container stoppen

log "Container stoppen"

cd "$(dirname "$COMPOSE_FILE")"

docker-compose down

# Datenbank-Backup mit Kompression

log "Datenbank-Backup erstellen"

docker run --rm \

-v nextcloud_db:/var/lib/MySQL 8.0 kaufen \

-v "$BACKUP_DIR":/backup \

--network none \

mysql:8.0 \

sh -c "mysqldump --single-transaction --routines --triggers -u nextcloud -p\$MYSQL_PASSWORD nextcloud | gzip > /backup/database_$DATE.sql.gz"

# Volume-Backups mit Hardlinks für Deduplication

log "Dateien-Backup erstellen"

if [[ -f "$BACKUP_DIR/files_latest.tar.gz" ]]; then

LINK_DEST="--link-dest=$BACKUP_DIR/files_latest.tar.gz"

else

LINK_DEST=""

fi

tar --create --gzip --file="$BACKUP_DIR/files_$DATE.tar.gz" \

--directory=/var/lib/docker/volumes/nextcloud_data/_data \

$LINK_DEST .

tar --create --gzip --file="$BACKUP_DIR/config_$DATE.tar.gz" \

--directory=/var/lib/docker/volumes/nextcloud_config/_data .

# Symlinks für latest-Backups

ln -sf "files_$DATE.tar.gz" "$BACKUP_DIR/files_latest.tar.gz"

ln -sf "config_$DATE.tar.gz" "$BACKUP_DIR/config_latest.tar.gz"

ln -sf "database_$DATE.sql.gz" "$BACKUP_DIR/database_latest.sql.gz"

# Container wieder starten

log "Container starten"

docker-compose up -d

# Warten bis Nextcloud verfügbar

log "Warte auf Nextcloud-Verfügbarkeit"

for i in {1..30}; do

if docker exec nextcloud-app php occ status --output=json | grep -q '"installed":true'; then

break

fi

sleep 10

done

# Wartungsmodus deaktivieren

docker exec nextcloud-app php occ maintenance:mode --off

unset MAINTENANCE_MODE

# Backup-Integrität prüfen

log "Backup-Integrität prüfen"

if ! tar -tzf "$BACKUP_DIR/files_$DATE.tar.gz" >/dev/null 2>&1; then

log "ERROR: Dateien-Backup korrupt"

exit 1

fi

if ! gunzip -t "$BACKUP_DIR/database_$DATE.sql.gz" 2>/dev/null; then

log "ERROR: Datenbank-Backup korrupt"

exit 1

fi

# Alte Backups löschen

log "Alte Backups löschen (älter als $RETENTION_DAYS Tage)"

find "$BACKUP_DIR" -name "*.tar.gz" -mtime +$RETENTION_DAYS -delete

find "$BACKUP_DIR" -name "*.sql.gz" -mtime +$RETENTION_DAYS -delete

# Backup-Größe loggen

BACKUP_SIZE=$(du -sh "$BACKUP_DIR/files_$DATE.tar.gz" | cut -f1)

log "Backup abgeschlossen - Größe: $BACKUP_SIZE"3. Script-Permissions und Cron-Setup:

chmod +x ~/nextcloud-backup.sh

sudo chown root:root ~/nextcloud-backup.sh

# Crontab mit Fehlerbehandlung

crontab -e

# Täglich 2:00 Uhr, Wöchentlich Sonntag 3:00, Monatlich 1. Tag 4:00

0 2 * * * /home/$USER/nextcloud-backup.sh daily 2>&1

0 3 * * 0 /home/$USER/nextcloud-backup.sh weekly 2>&1

0 4 1 * * /home/$USER/nextcloud-backup.sh monthly 2>&1Variante 2: NAS-System mit ZFS Snapshots

1. Synology DSM Advanced Setup:

# SSH aktivieren: Control Panel > Terminal & SNMP

# Shared Folder erstellen: /volume1/nextcloud-backup

# Hyper Backup Package installieren2. Snapshot-basierte Backups konfigurieren:

# Snapshot Replication einrichten

# Source: Nextcloud Docker Host

# Destination: /volume1/nextcloud-backup

# Schedule: Alle 6 Stunden

# Retention: 24 Snapshots (4 Tage)Variante 3: Rsync mit Bandwidth-Limiting

1. SSH-Schlüssel mit Restrictions:

ssh-keygen -t ed25519 -f ~/.ssh/nextcloud_backup

echo 'command="rsync --server --daemon .",restrict' >> ~/.ssh/authorized_keys2. Rsync-Daemon Konfiguration:

# /etc/rsyncd.conf

[nextcloud-backup]

path = /backup/nextcloud

read only = false

hosts allow = 192.168.1.0/24

auth users = backup

secrets file = /etc/rsyncd.secrets

max connections = 2

timeout = 3003. Bandwidth-limitiertes Backup-Script:

#!/bin/bash

REMOTE_HOST="backup-server.local"

BANDWIDTH_LIMIT="10000" # KB/s

rsync -avz --delete --bwlimit=$BANDWIDTH_LIMIT \

--exclude='*.tmp' --exclude='*.lock' \

/var/lib/docker/volumes/nextcloud_data/_data/ \

rsync://$REMOTE_HOST/nextcloud-backup/data/Für Performance-Optimierungen nach dem Backup siehe unseren Nextcloud Performance optimieren Guide.

Häufige Fehler beim Nextcloud Docker Backup

| Fehlerbild | Ursache | Lösung |

|---|---|---|

| Backup bricht nach 50% ab mit No space left on device“ | Backup-Partition zu klein oder alte Backups nicht gelöscht | df -h prüfen, Retention-Policy implementieren: find /backup -mtime +7 -delete |

| Database dump schlägt fehl: Access denied for user“ | Falsche Datenbank-Credentials oder Container läuft nicht | Environment-Variablen prüfen: docker exec nextcloud-db env | grep MYSQL |

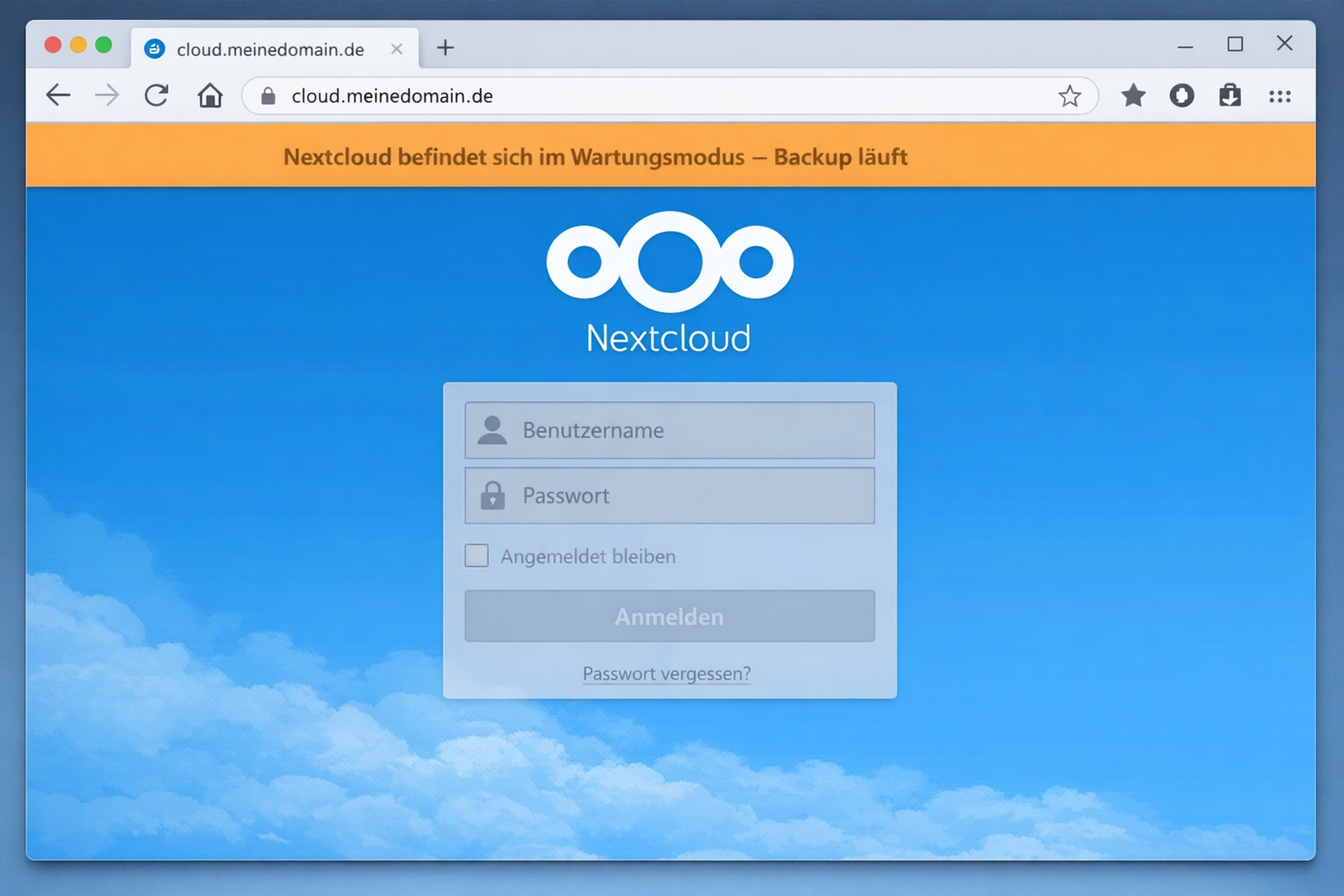

| Nextcloud startet nach Backup nicht: Database is locked“ | Backup lief während aktiver Datenbankverbindungen | Wartungsmodus vor Container-Stop: docker exec nextcloud-app php occ maintenance:mode --on |

| Restore schlägt fehl: File exists but is corrupted“ | Backup wurde während laufendem System ohne Wartungsmodus erstellt | Backup-Integrität prüfen: tar -tzf backup.tar.gz | head -10 |

| Cron-Job läuft nicht: Permission denied“ | Script nicht ausführbar oder SELinux blockiert | chmod +x script.sh und setsebool -P cron_can_relabel 1 |

| Backup dauert 8+ Stunden bei 50GB Daten | Keine inkrementellen Backups, I/O-Bottleneck | Rsync mit --link-dest und ionice -c3 verwenden |

| Docker Volume Pfad nicht gefunden | Volume-Name geändert oder falscher Docker-Root | Aktuelle Pfade ermitteln: docker volume inspect nextcloud_data |

| Backup-Script hängt bei mysqldump | InnoDB-Deadlock oder zu wenig RAM | --single-transaction --quick --lock-tables=false Parameter hinzufügen |

Restore-Prozess: Backup wiederherstellen

Point-in-Time Recovery

1. Backup-Zeitpunkt identifizieren:

ls -la /backup/nextcloud/daily/

# Wähle gewünschten Zeitstempel, z.B. 20241201_0200002. Aktuelle Installation sichern (falls noch funktional):

docker exec nextcloud-app php occ maintenance:mode --on

docker-compose -f /home/$USER/nextcloud/docker-compose.yml down

# Aktuelle Volumes als Backup

docker run --rm -v nextcloud_data:/source -v /backup/emergency:/dest alpine \

tar -czf /dest/emergency_data_$(date +%s).tar.gz -C /source .3. Volumes komplett zurücksetzen:

docker volume rm nextcloud_data nextcloud_config nextcloud_db

docker volume create nextcloud_data

docker volume create nextcloud_config

docker volume create nextcloud_db4. Datenbank mit Konsistenz-Checks wiederherstellen:

# Temporären DB-Container starten

docker run -d --name temp-db \

-e MYSQL_ROOT_PASSWORD=temppass \

-e MYSQL_DATABASE=nextcloud \

-e MYSQL_USER=nextcloud \

-e MYSQL_PASSWORD=DEIN_PASSWORT \

-v nextcloud_db:/var/lib/mysql \

mysql:8.0

sleep 30

# Backup einspielen

gunzip -c /backup/nextcloud/daily/database_20241201_020000.sql.gz | \

docker exec -i temp-db mysql -u nextcloud -pDEIN_PASSWORT nextcloud

# Konsistenz prüfen

docker exec temp-db mysql -u nextcloud -pDEIN_PASSWORT nextcloud \

-e "CHECK TABLE oc_filecache, oc_storages, oc_mounts;"

docker stop temp-db && docker rm temp-db5. Dateien mit Permissions wiederherstellen:

# Data-Volume

docker run --rm -v nextcloud_data:/data -v /backup/nextcloud/daily:/backup alpine \

sh -c "tar -xzf /backup/files_20241201_020000.tar.gz -C /data && chown -R 33:33 /data"

# Config-Volume

docker run --rm -v nextcloud_config:/config -v /backup/nextcloud/daily:/backup alpine \

sh -c "tar -xzf /backup/config_20241201_020000.tar.gz -C /config && chown -R 33:33 /config"6. Nextcloud starten und Integrität prüfen:

docker-compose -f /home/$USER/nextcloud/docker-compose.yml up -d

# Warten bis verfügbar

sleep 60

# Systemcheck

docker exec nextcloud-app php occ status

docker exec nextcloud-app php occ db:add-missing-indices

docker exec nextcloud-app php occ files:scan --all

docker exec nextcloud-app php occ maintenance:mode --offGranulare Datei-Wiederherstellung

Einzelne Dateien ohne komplettes Restore wiederherstellen:

# Backup mounten

mkdir /tmp/backup-mount

tar -xzf /backup/nextcloud/daily/files_20241201_020000.tar.gz -C /tmp/backup-mount

# Spezifische Datei kopieren

docker cp /tmp/backup-mount/admin/files/wichtiges_dokument.pdf \

nextcloud-app:/var/www/html/data/admin/files/

# Nextcloud-Scan für neue Datei

docker exec nextcloud-app php occ files:scan admin

Cloud-Backup als zusätzliche Sicherheit

Rclone Setup mit Verschlüsselung

1. Rclone mit Crypt-Backend konfigurieren:

curl https://rclone.org/install.sh | sudo bash

rclone config

# Konfiguration:

# 1. Google Drive Remote erstellen

# 2. Crypt Remote über Google Drive

# 3. Verschlüsselungspasswort setzen2. Verschlüsseltes Cloud-Backup mit Bandwidth-Limiting:

#!/bin/bash

CLOUD_REMOTE="gdrive-crypt:nextcloud-backup"

LOCAL_BACKUP="/backup/nextcloud/daily"

BANDWIDTH_LIMIT="5M" # 5 MB/s

# Nur neueste Backups in Cloud

rclone copy "$LOCAL_BACKUP" "$CLOUD_REMOTE" \

--include="*latest*" \

--bwlimit="$BANDWIDTH_LIMIT" \

--transfers=2 \

--checkers=4 \

--progress \

--log-file=/var/log/rclone-backup.logMulti-Cloud Strategie

Verschiedene Cloud-Provider für maximale Ausfallsicherheit:

# Primär: Google Drive (schnell, günstig)

rclone copy /backup/nextcloud/daily gdrive-crypt:nextcloud/daily

# Sekundär: AWS S3 Glacier (langfristig, sehr günstig)

rclone copy /backup/nextcloud/weekly s3-glacier:nextcloud-backup/weekly

# Tertiär: Backblaze B2 (Mittelweg)

rclone copy /backup/nextcloud/monthly b2-crypt:nextcloud/monthly3-2-1-Backup-Regel mit Kostenoptimierung

| Kopie | Speicherort | Technologie | Aufbewahrung | Monatliche Kosten (500GB) |

|---|---|---|---|---|

| 1. Produktiv | Lokaler Server | Docker Volumes | Live | 0€ |

| 2. Lokal | NAS/USB-Festplatte | Rsync/ZFS Snapshots | 30 Tage | 0€ |

| 3. Cloud Primär | Google Drive | Rclone + Verschlüsselung | 90 Tage | ca. 8€ |

| 4. Cloud Archiv | AWS S3 Glacier | Rclone + Lifecycle | 7 Jahre | ca. 2€ |

Für SSL-Konfiguration und Domain-Setup siehe unseren Nextcloud Reverse Proxy einrichten Guide.

Monitoring und Alerting

Backup-Status Dashboard

1. Prometheus Metrics für Backup-Monitoring:

# /etc/prometheus/backup-exporter.sh

#!/bin/bash

METRICS_FILE="/var/lib/prometheus/node-exporter/backup.prom"

# Letztes Backup-Datum

LAST_BACKUP=$(stat -c %Y /backup/nextcloud/daily/files_latest.tar.gz 2>/dev/null || echo 0)

echo "nextcloud_backup_last_success_timestamp $LAST_BACKUP" > "$METRICS_FILE"

# Backup-Größe

BACKUP_SIZE=$(stat -c %s /backup/nextcloud/daily/files_latest.tar.gz 2>/dev/null || echo 0)

echo "nextcloud_backup_size_bytes $BACKUP_SIZE" >> "$METRICS_FILE"

# Verfügbarer Speicherplatz

AVAILABLE=$(df /backup | tail -1 | awk '{print $4}')

echo "nextcloud_backup_disk_available_kb $AVAILABLE" >> "$METRICS_FILE"2. Grafana Dashboard für Backup-Überwachung:

{

"dashboard": {

"title": "Nextcloud Backup Status",

"panels": [

{

"title": "Backup Age",

"type": "stat",

"targets": [{

"expr": "(time() - nextcloud_backup_last_success_timestamp) / 3600"

}]

}

]

}

}E-Mail Alerts bei Backup-Fehlern

1. SMTP-Setup für Benachrichtigungen:

# /etc/msmtprc

defaults

auth on

tls on

tls_trust_file /etc/ssl/certs/ca-certificates.crt

logfile /var/log/msmtp.log

account gmail

host smtp.gmail.com

port 587

from backup@yourdomain.com

user backup@yourdomain.com

password your-app-password2. Alert-Script in Backup integrieren:

send_alert() {

local status="$1"

local message="$2"

echo "Subject: Nextcloud Backup $status

Backup Status: $status

Timestamp: $(date)

Server: $(hostname)

Message: $message

Backup Details:

$(ls -la /backup/nextcloud/daily/ | tail -5)" | \

msmtp admin@yourdomain.com

}

Debug-Sequence: Backup-Probleme systematisch lösen

1. Container-Status und Logs analysieren:

docker ps -a --format "table {{.Names}}\t{{.Status}}\t{{.Ports}}"

docker logs --tail=50 nextcloud-app

docker logs --tail=50 nextcloud-db2. Speicherplatz und I/O-Performance prüfen:

df -h /backup /var/lib/docker

iostat -x 1 5

sudo iotop -ao3. Datenbank-Verbindung und -Integrität testen:

docker exec nextcloud-db mysql -u nextcloud -p -e "SHOW PROCESSLIST;"

docker exec nextcloud-db mysql -u nextcloud -p -e "SHOW ENGINE INNODB STATUS\G" | grep -A10 "LATEST DETECTED DEADLOCK"4. Docker Volume Konsistenz prüfen:

docker volume inspect nextcloud_data nextcloud_config nextcloud_db

sudo ls -la /var/lib/docker/volumes/nextcloud_*/

sudo du -sh /var/lib/docker/volumes/nextcloud_*5. Backup-Integrität mit Checksums validieren:

# Checksums erstellen

find /backup/nextcloud/daily -name "*.tar.gz" -exec sha256sum {} \; > /backup/checksums.txt

# Checksums prüfen

sha256sum -c /backup/checksums.txt6. Netzwerk-Connectivity für Remote-Backups:

ping -c3 backup-server.local

nc -zv backup-server.local 22

ssh -o ConnectTimeout=5 backup@backup-server.local "df -h /backup"Für die Docker-Grundlagen siehe unseren Docker und Docker Compose installieren Guide.

Backup-Performance Optimierung

I/O-Scheduling und Prioritäten

# Backup mit niedriger I/O-Priorität

ionice -c3 nice -n19 ./nextcloud-backup.sh

# Parallele Kompression nutzen

tar --create --use-compress-program="pigz -p4" \

--file="backup_$(date +%s).tar.gz" /dataInkrementelle Backups mit Hardlinks

# Rsync mit Hardlink-Deduplication

rsync -avH --link-dest=/backup/previous/ \

/var/lib/docker/volumes/nextcloud_data/_data/ \

/backup/current/Weitere Optimierungen für größere Installationen findest du in unserem NAS selber bauen: Hardware-Guide.

Fazit

Ein automatisches Nextcloud-Backup verhindert Datenverlust bei Hardware-Defekt oder Fehlkonfiguration. In der Praxis zeigt sich: Script-basierte Lösungen funktionieren sofort mit vorhandener Hardware, NAS-Systeme bieten höhere Zuverlässigkeit für kritische Anwendungen, Cloud-Backups sind unverzichtbar für Offsite-Sicherheit.

Die 3-2-1-Regel (3 Kopien, 2 verschiedene Medien, 1 Offsite) ist bei Nextcloud besonders wichtig, da zentrale Datenhaltung bedeutet: Ein Ausfall betrifft alle Nutzer gleichzeitig. Teste deine Restore-Prozedur regelmäßig – ein ungetestetes Backup ist wertlos.

Für umfassende Server-Setups siehe unseren Home Server Hardware und Betriebssystem Guide.

Unsere Empfehlungen

* Affiliate-Links – beim Kauf erhalten wir ggf. eine Provision.

Preisvergleich

| Produkt | smartkram | Fachhandel | Amazon | eBay |

|---|---|---|---|---|

| Raspberry Pi 4 8GB | smartkram ↗ | reichelt elektronik DE ↗ | Amazon ↗ | eBay ↗ |

| Intel NUC i5 | — | cyberport DE ↗ | Amazon ↗ | eBay ↗ |

| Synology DS220+ | — | cyberport DE ↗ | Amazon ↗ | eBay ↗ |

| QNAP TS-464 | — | cyberport DE ↗ | Amazon ↗ | eBay ↗ |

| MySQL 8.0 | — | — | Amazon ↗ | eBay ↗ |

* Affiliate-Links – beim Kauf erhalten wir ggf. eine Provision.